CVPR2020 EIL 对抗擦除集成学习

Erasing Integrated Learning : A Simple yet Effective Approach for Weakly Supervised Object Localization

背景

基于分类网络的WSOL方法通常会突出显示最具辨别力的部分,而不是对象的整个范围。然而,试图探索对象的整体范围反而会降低图像分类的性能。

CAM定位得到的往往是对应类别最具判别性的部分,对抗擦除技术用于缓解这一问题

ADL随机擦除前向传播中最具辨别力的区域,节省了相当多的计算和参数开销。但ADL 仍然受到信息区域随机丢失引起的分类退化的限制。当 ADL 插入网络时,它随机选择擦除最具辨别力的区域或突出显示特征图中的信息区域。但是随机擦除会以某种方式丢弃重要信息,从而导致分类性能下降。

ACoL 在顶部应用两个并行分类器来训练网络,一个直接从共享骨干网输入未擦除的特征图并生成擦除掩码,而另一个通过此掩码输入擦除的特征图。

SeeNet 针对对象和背景线索引入了两种自擦除策略,可以防止注意力转移到背景区域,从而更准确地挖掘对象。

HaS随机隐藏给定图像的补丁,以迫使网络寻找对象的更多相关部分,这也可以被认为是一种数据增强方式。

DANet 借助对对象类别层次结构的更强监督,利用跨类别语义差异和空间差异来学习互补和有区别的视觉模式。

soft proposal network

SPG

EIL方法概述

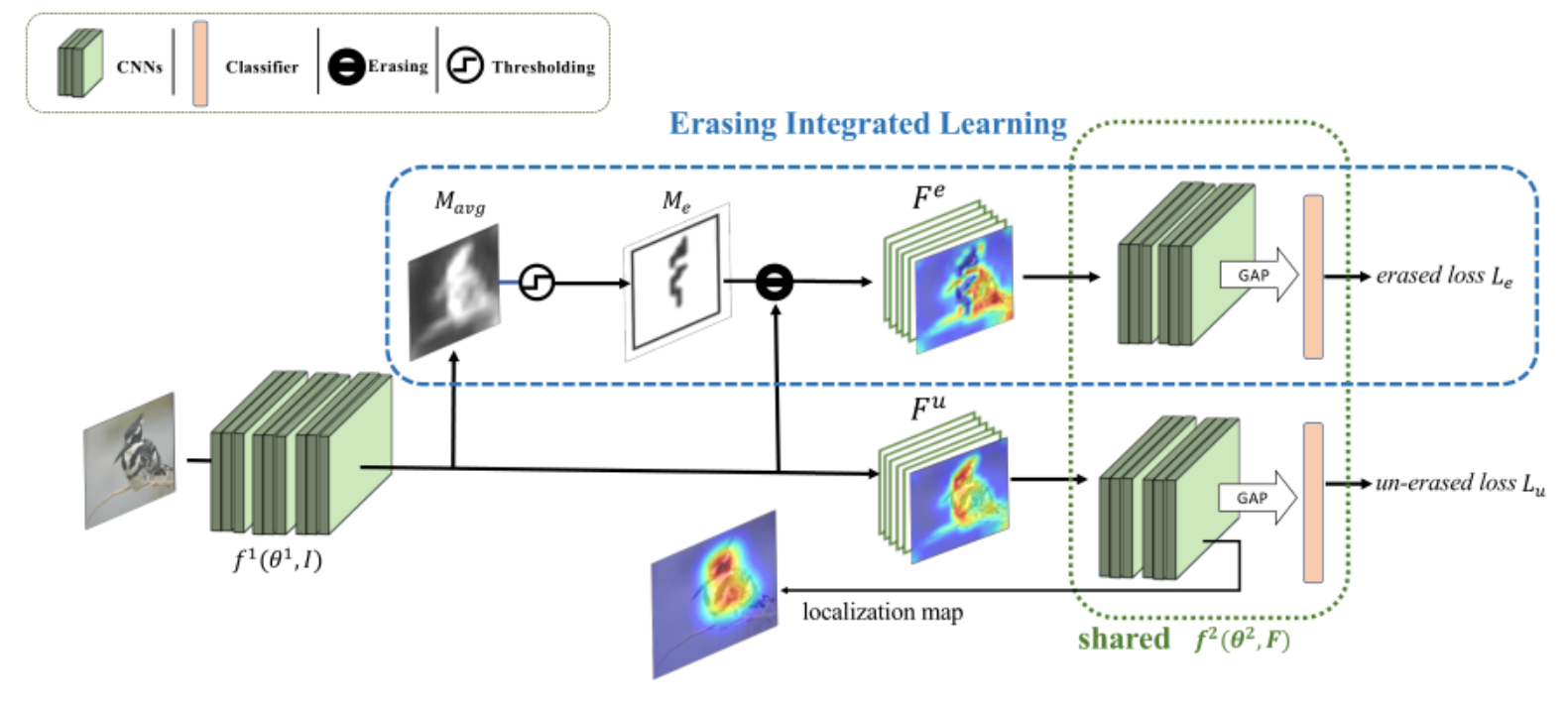

首先按照ADL中的掩码生成方法,利用channel wise avgpooling得到自注意力图,经过阈值筛选后得到Drop mask。然后使用Drop mask对原特征图进行擦除,将擦除后的和未擦除的特征图一起送入下一个卷积块,可以视作创建了擦除和未擦除两个数据流,网络参数权重共享,对擦除数据和未擦除数据分别产生两个分类损失,通过未擦除的损失,网络可以学习通过最具辨别力的类特定区域对对象进行分类。擦除的损失促使网络将注意力集中在判别力较低的部分以探索互补对象区域。在测试阶段EIL模块是不起作用的,直接使用普通模型得到注意力图。

消融实验证明了两个流产生的梯度不会冲突或相互抵消

实验结果

Datasets

- CUB-200-2011

- ILSVRC 2016

Metrics

Top-1 classification accuracy

Top-1 localization accuracy

localization accuracy with known ground-truth class (GT Loc)